Confiance-Calibration

Nous introduisons une nouvelle notion : la calibration d’un réseau. Cette notion permet d’estimer le niveau de confiance que l’on peut accorder aux probabilités prédites par un réseau de neurones.

Contexte

L’accuracy mesure le pourcentage de prédictions correctes et fournit une estimation globale des performances d’un réseau. La notion de calibration (ou de confiance) est différente.

Chacune de ces notions répond à une question distincte :

Accuracy : « Globalement, est-ce que le modèle a raison ? »

Calibration : « Lorsque le modèle est sûr de lui, peut-on lui faire confiance ? »

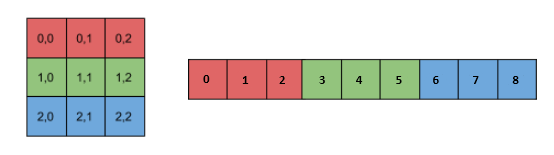

On rappelle que la fonction SoftMax, en sortie du réseau, fournit des probabilités associées à chaque classe.

Un modèle est dit correctement calibré lorsque, si l’on considère toutes les prédictions pour lesquelles le modèle annonce une classe avec une probabilité p (plus précisément dans un intervalle [p − α, p + α]), la proportion de prédictions correctes parmi celles-ci est proche de p.

Ainsi, dans un modèle correctement calibré, la probabilité de la classe retenue en sortie de la fonction SoftMax peut être interprétée comme un niveau de confiance.

Exemple 1

Prenons l’exemple d’une tâche de classification chat vs chien. On note \(p(\text{chien})\) la probabilité associée à la classe chien en sortie de la fonction SoftMax. On considère que la classe prédite est chien lorsque \(p(\text{chien}) > 0.5\), et chat sinon. Comme il n’y a que deux classes, on rappelle que : \(p_{\text{chat}} = 1 - p_{\text{chien}}\).

L’accuracy globale de ce réseau, i.e. le taux de bonnes réponses, est de 9/15 = 60%.

Prenons maintenant l’intervalle de confiance [90%, 100%]. Nous avons 5 prédictions qui donnent la catégorie chien, pourtant le taux de bonnes réponses dans cet intervalle n’est que de 40%. Dans cette configuration, le modèle est sur-confiant (overconfident) : la probabilité annoncée en sortie du réseau pour chien est largement supérieure à la réalité observée sur le terrain.

Si l’on étudie la tranche [60%, 70%], le taux de bonnes réponses est de 60%. Ici, la probabilité annoncée par le modèle — « j’ai l’impression de voir un chien à 62%/68% » — est proche de la fréquence observée. Le modèle est donc nettement mieux calibré dans cette zone.

Sur la tranche [50%, 60%], le taux de bonnes réponses est de 80%. Ainsi la probabilité en sortie du modèle est inférieure à la réalité terrain : le modèle a plus souvent raison que ce qu’il croit, on dit qu’il est sous-confiant (underconfident).

Rappel : en pratique, la notion de confiance est généralement étudiée par rapport à la classe prédite (one-vs-all).

Exemple 2

Considérons maintenant le jeu de pile ou face. Lorsqu’on lui demande de prédire l’avenir, un modèle bien calibré répondra 50% pour pile et 50% pour face. Sa prédiction est réaliste : le modèle est parfaitement calibré. Même en étant parfaitement calibré, l’accuracy de ce modèle n’atteint que 50%. Calibration parfaite ne sous-entend pas une accuracy de 100%.

Considérons un autre modèle qui donne systématiquement 100% pour face. En termes d’accuracy, il obtient exactement la même performance (50%). En revanche, du point de vue de la calibration, il est totalement hors jeu : les probabilités annoncées sont très éloignées de la réalité observée.

Exemple 3

Question : Un modèle qui produit des prédictions correctes avec une probabilité proche de 100 % n’est-il pas l’idéal ?

Réponse : Non. C’est un piège classique. Un réseau qui attribue systématiquement des probabilités très proches de 1 peut paraître séduisant : on a l’impression qu’il « sait vraiment » et qu’il a « parfaitement appris sa leçon ». Pourtant, cette situation est suspecte.

Dans des données réelles, les labels peuvent être bruités, certaines images sont ambiguës et certaines classes sont visuellement proches. Une confiance absolue est donc rarement justifiée. Un modèle excessivement confiant tend à être mal calibré et peut devenir peu fiable sur de nouvelles données : de faibles variations de l’entrée peuvent provoquer des changements brusques de prédiction.

En pratique, une bonne prédiction correspond plutôt à une probabilité élevée mais raisonnable (par exemple entre 0.7 et 0.9). Des probabilités systématiquement saturées indiquent souvent que le modèle utilise sa capacité pour renforcer des prédictions déjà correctes, au lieu d’améliorer ses décisions sur les cas difficiles. La capacité du réseau est alors mobilisée pour favoriser la sur-confiance, et non pas pour améliorer la généralisation (capacité du modèle à faire une prédiction correcte sur une image qu’il n’a jamais vue).

Remarque

Les problèmes de mauvaise calibration ne se limitent pas à la sur- ou sous-confiance. A titre d’exemple, un modèle peut produire des prédictions erronées :

sur des images floues

sur une classe en particulier

dans certaines conditions spécifiques

Conclusion

On dit qu’un modèle est :

mal calibré lorsque : les probabilités prédites ne correspondent pas à la réalité.

Voici deux exemples parmi d’autres :

en sur-confiance (overconfidence) lorsque les probabilités prédites sont supérieures à la réalité

en sous-confiance (underconfidence) lorsque les probabilités prédites sont inférieures à la réalité

bien calibré lorsque les probabilité prédites sont en accord avec la réalité